Data & Analytics Blog

Die Verwaltung von SQL Server Reporting Services (SSRS) in großen Organisationen kann schnell komplex werden. Wie Sie diese Herausforderung meistern.

Data & Analytics Blog

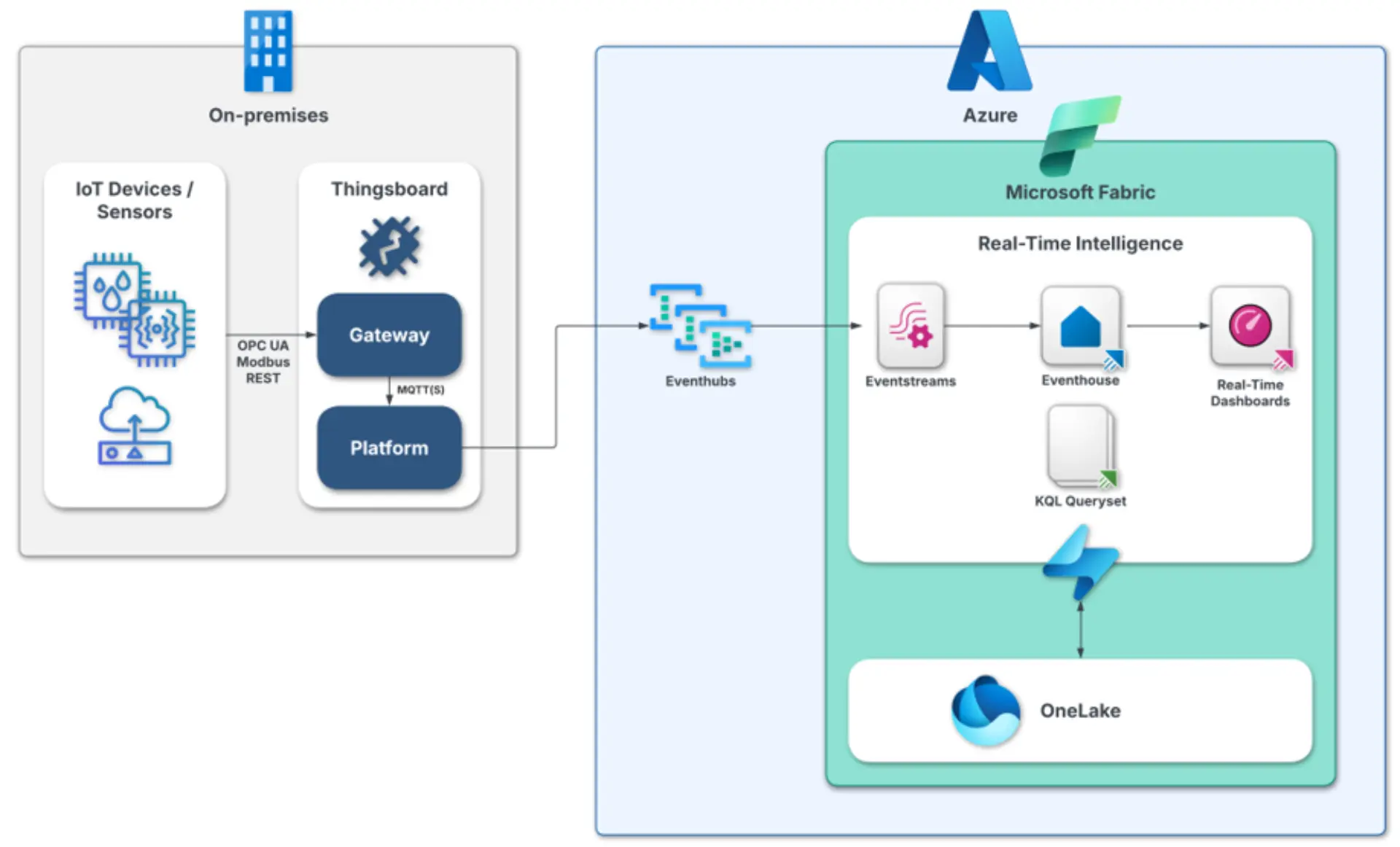

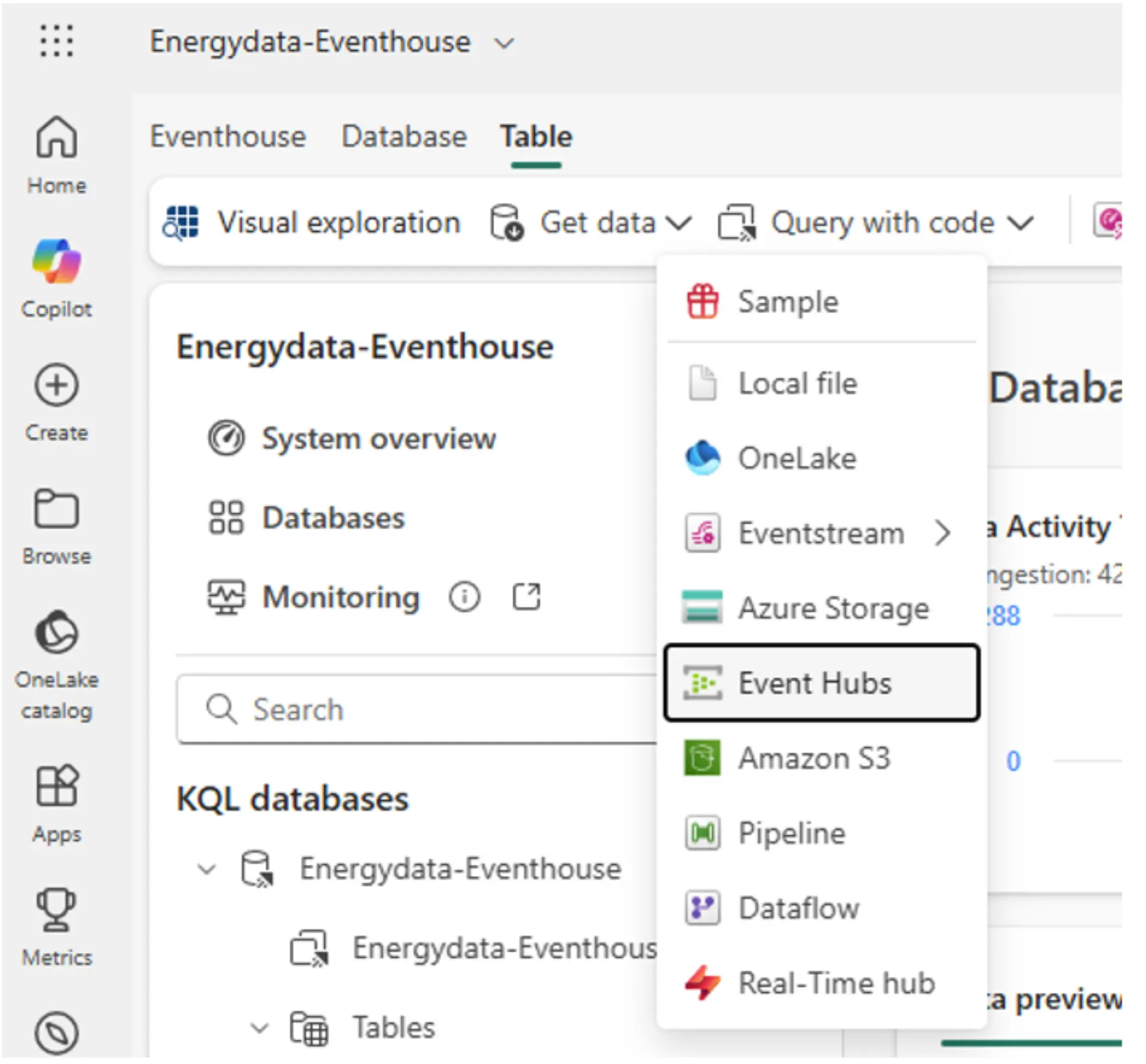

Viele Unternehmen stehen heute vor dieser Herausforderung: Ihre Daten- und ETL-Landschaften sind über Jahre organisch gewachsen, bestehen aus heterogenen Komponenten und enthalten unzählige, teils undokumentierte Skripte. Diese Legacy-Systeme bilden zwar das Rückgrat der operativen Datenverarbeitung, stellen jedoch ein massives Hindernis für Innovation und Cloud-Modernisierung dar.

Data & Analytics Blog

Die Nutzung von Cloud-Computing-Leistungen in Unternehmen ist weiter auf dem Vormarsch: Im Sommer 2024 nutzten laut einer repräsentativen bitkom Studie 81% der befragten Unternehmen in Deutschland bereits Cloud-Dienste, Tendenz weiterhin steigend. Unter den befragten Unternehmen herrscht Konsens darüber, dass die Cloud die Unternehmens-IT künftig dominieren wird.

Data & Analytics Blog

Warum der Erfolg eines Data Catalogs weniger von Technologie als von klarer Vision, organisatorischer Verankerung und gezieltem Kulturwandel abhängt.

Data & Analytics Blog

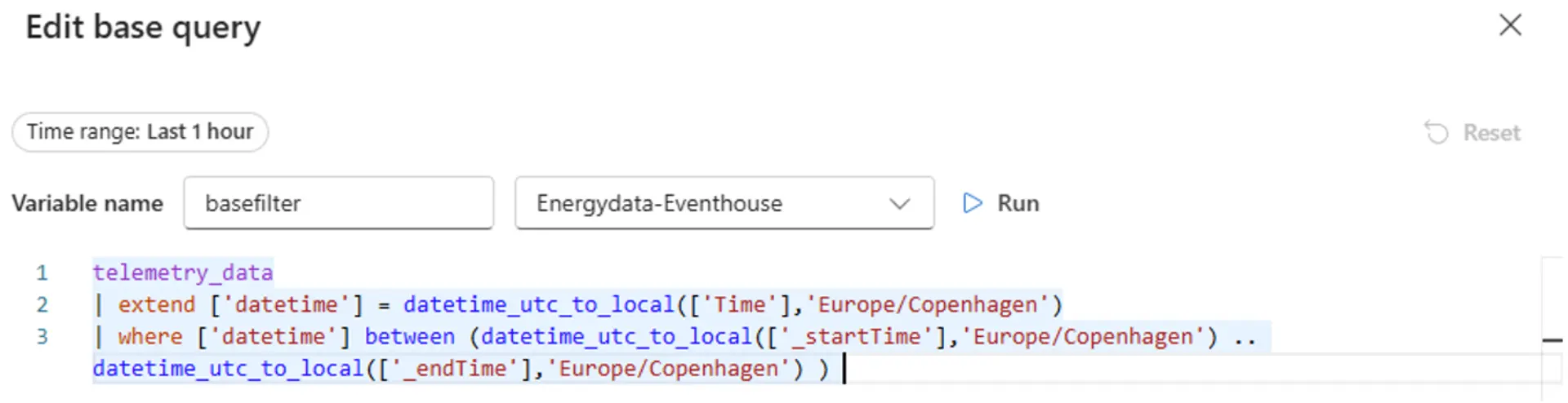

Viele Performance-Probleme lassen sich bereits mit kleinen Anpassungen beheben. Die folgenden Tipps zeigen, wie sich Abfragen gezielt optimieren lassen, um das volle Leistungspotenzial auszuschöpfen.

Data & Analytics Blog

Wenn Unternehmen wachsen, wächst auch ihre Datenlandschaft oft schneller, als sie verwaltet werden kann. Organisationen müssen verstehen, welche Daten sie besitzen, wo sie liegen, wer sie nutzt und ob sie verlässlich sind. Um dieses Problem zu adressieren, entstand eine neue Kategorie an Softwarelösungen: Data Catalogs.

Data & Analytics Blog

Agentic AI ermöglicht Systeme, die denken, sich anpassen und zusammenarbeiten – weit über statische Automatisierung hinaus. Erfahre, wie vier zentrale Designmuster dieses Konzept in echten Geschäftsnutzen verwandeln.

Data & Analytics Blog

900 GB Testdaten in nur 2 Stunden? Mit Databricks kein Problem. In diesem Artikel zeigen wir, wie msg die Generierung synthetischer Daten mit Spark auf Databricks skaliert hat – schnell, effizient und vollständig reproduzierbar. Ideal für echtes Benchmarking und Performance-Tests.